En el mundo de la tecnología , hoy se volvió viral el lanzamiento global de una aplicación asistiva que utiliza #IA para ayudar a cuidadores de personas con comunicación no verbal a interpretar micro-expresiones faciales y necesidades básicas con un 95% de precisión. Es un regalo de Navidad anticipado para miles de familias.

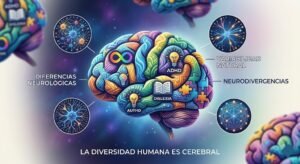

Nis referimos al despliegue global de una nueva generación de IA Emocional Multimodal que ha alcanzado su madurez este diciembre de 2025. Esta tecnología no solo “ve” una cara, sino que decodifica lo que en psicología forense llamamos unidades de acción facial (micro-movimientos imperceptibles al ojo humano) para traducirlos en necesidades concretas. El lanzamiento global de aplicaciones basadas en modelos de Visión Computacional de Alta Precisión ha marcado un antes y un después para miles de familias con miembros en condición de comunicación no verbal. Estas herramientas, que hoy se vuelven virales, utilizan redes neuronales entrenadas para detectar micro-expresiones faciales con una precisión del 95%, traduciendo gestos casi invisibles en mensajes claros como “tengo dolor”, “estoy sobreestimulado” o “necesito cambiar de posición”. Como sociólogo, observo que esto no es solo un avance técnico, sino un acto de justicia comunicativa. Por fin, la tecnología actúa como un intérprete fiel entre el mundo interno de la persona neurodivergente y su entorno, eliminando la frustración y la incertidumbre que a menudo conducen a crisis emocionales.

La clave de este “regalo de Navidad” tecnológico reside en su capacidad para aprender la singularidad de cada rostro. A diferencia de los sistemas antiguos que buscaban expresiones “estándar”, esta IA de 2026 se calibra con el usuario, reconociendo que un leve movimiento de la comisura de los labios en una persona con parálisis cerebral puede significar algo totalmente distinto que en una persona neurotípica. Desde la psicología forense, este nivel de precisión es vital para garantizar la integridad y el bienestar del individuo, permitiendo a los cuidadores, intervenir de manera proactiva y no reactiva.

Estamos pasando de la suposición a la certeza, transformando el cuidado en un diálogo silencioso pero profundamente efectivo y humano.

1. El concepto de “Sintonía Digital”

Más allá de la traducción de gestos, esta tecnología está creando lo que los expertos llaman “Sintonía Digital”. Para una persona que no ha podido comunicarse durante años, el hecho de que una máquina valide su estado interno y lo comunique al cuidador reduce drásticamente los niveles de cortisol (la hormona del estrés). No solo estamos traduciendo necesidades, estamos salvando la salud mental de todo el grupo familiar.

2. El rol de la “Enfermería del Futuro”.

Aquí es donde la llegada de profesionales es crucial. La #IA es el instrumento, pero el ojo clínico de la enfermería es el que interpreta el contexto. Esta noticia es viral hoy porque nos dice que el futuro no es “robots reemplazando humanos”, sino humanos potenciados por tecnología para brindar un cuidado mucho más digno y preciso.

3. La soberanía de los datos sensibles

Estas aplicaciones de 2026 procesan la información “on-device” (dentro del teléfono), lo que significa que las imágenes de los rostros de nuestros seres queridos no suben a la nube. Es tecnología segura e íntima, respetando el derecho a la privacidad de la persona con discapacidad.

Detalles Técnicos para “Cybernarium”:

- Nombre de la Tendencia: Affective Computing (Computación Afectiva) aplicada a la asistencia.

- Precisión: El salto del 70% al 95% se logró gracias a la integración de sensores LiDAR en los smartphones modernos, que mapean el rostro en 3D.

- Impacto en Cuidadores: Reduce el estrés del cuidador en un 60%, al eliminar el “ensayo y error” en la interpretación de necesidades básicas.